KojimaFC escribió:Voy a probar con los ingame, ahora edito.Nomada_Firefox escribió:@KojimaFC En 4k no se, pero en 1440p no lo gasta. Deberias usar las graficas del juego que las tiene, se activan en opciones graficas. Ademas una cosita es tener 16GB y que el msi afterburner te diga que se usan todos y otra que realmente sean necesarios.

En 1440p con DLAA. No veo que llegue a 10.2GB. Pero si que no se juega nada bien.

O igual las metricas del juego estan mal. Pero si fuera asi, en DLSS calidad no iria suave precisamente.

@SECHI Lo he probado yo mismo con HDR y es lo que dije, que el HDR aumenta un monton todos los brillos, hasta la hierba se ve diferente. En este juego puede configurarse desde las opciones bastante bien, incluso puedes reducir la cantidad de brillo manteniendo cosas como la saturación de color, los blancos y negros. Asi que no creo que esos videos esten mostrando la realidad del asunto que es que el PT no se nota tanto. De hecho sin usar el PT, lo que más notas, es poner y quitar el HDR. Y tambien se puede conseguir algo aumentado con un brillo mayor a como suelo jugar yo donde en la calibración lo dejo de modo que apenas se vea. Lo cierto es que yo luego meto un perfil de color en el monitor que me resulta más comodo a la vista.

Bueno, a lo tonto y a lo bobo, no iba a jugarlo y ya complete el primer capitulo.

También te digo que a 4k el consumo de Vram se dispara, es normal.

Edito:

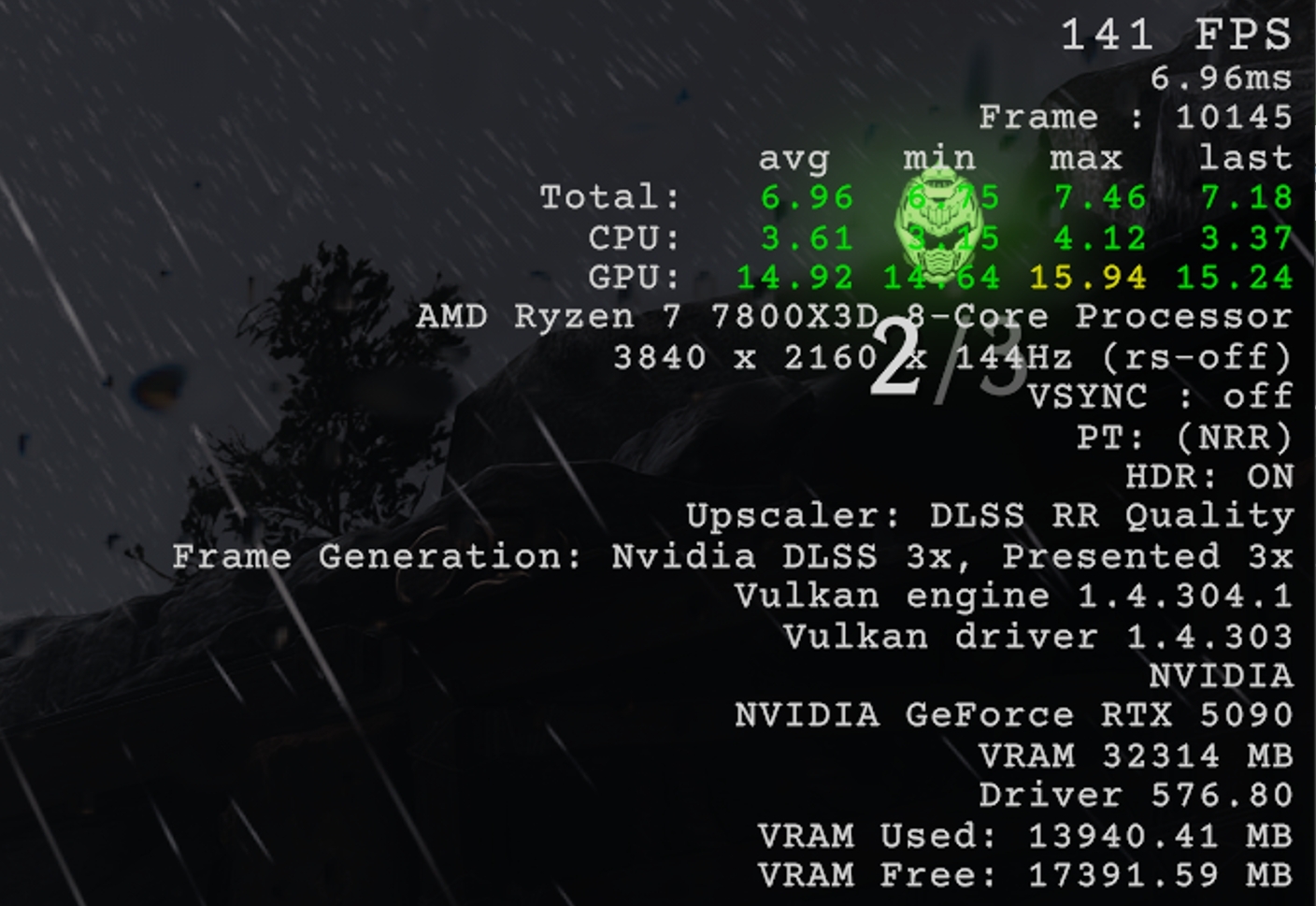

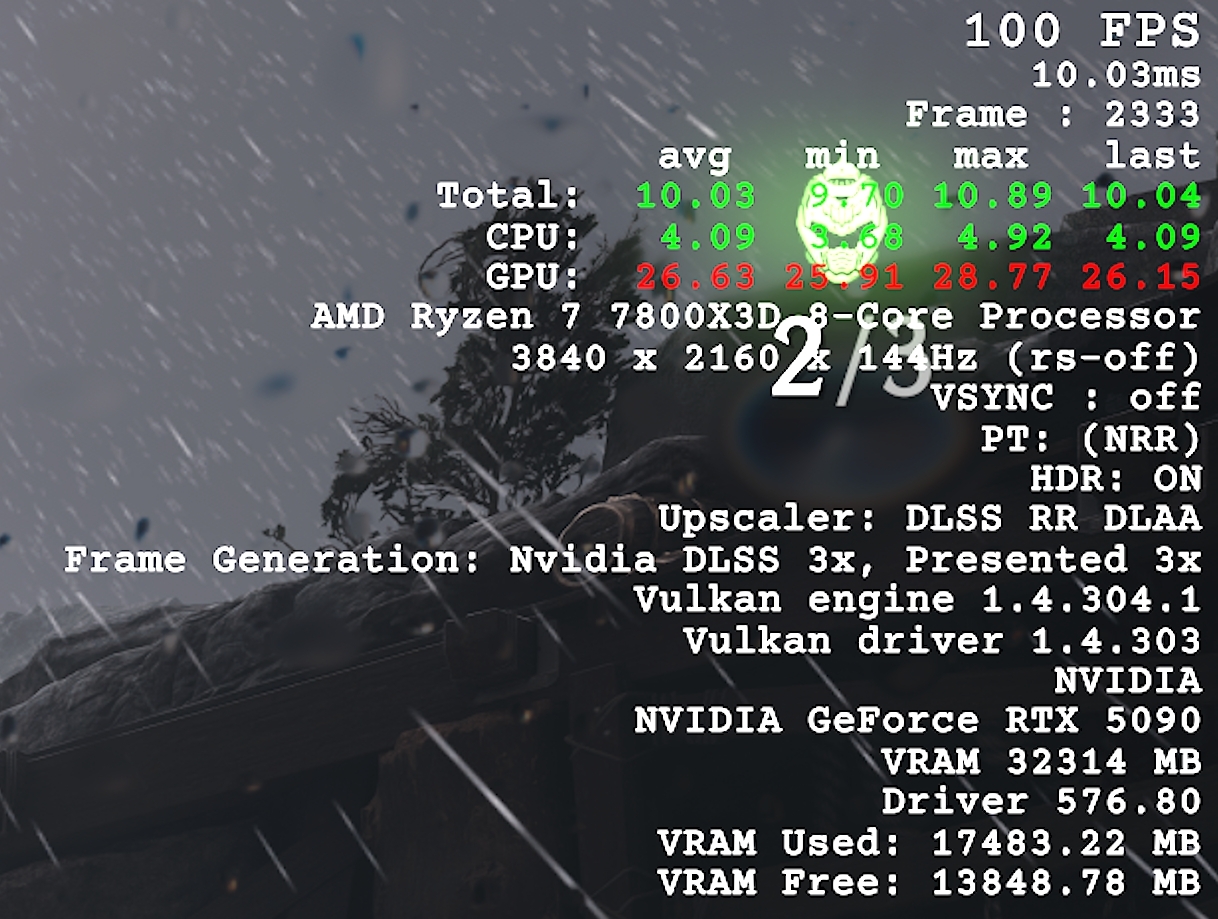

DLAA:

DLSS Calidad FG x3

Hay diferencias notables con MSI AB, alguien sabe por qué y cual es el impostor? xD

Sorry.. no me fijé en la resolución, a ver si ahora se ve mejor.Jezebeth escribió:KojimaFC escribió:Voy a probar con los ingame, ahora edito.Nomada_Firefox escribió:@KojimaFC En 4k no se, pero en 1440p no lo gasta. Deberias usar las graficas del juego que las tiene, se activan en opciones graficas. Ademas una cosita es tener 16GB y que el msi afterburner te diga que se usan todos y otra que realmente sean necesarios.

En 1440p con DLAA. No veo que llegue a 10.2GB. Pero si que no se juega nada bien.

O igual las metricas del juego estan mal. Pero si fuera asi, en DLSS calidad no iria suave precisamente.

@SECHI Lo he probado yo mismo con HDR y es lo que dije, que el HDR aumenta un monton todos los brillos, hasta la hierba se ve diferente. En este juego puede configurarse desde las opciones bastante bien, incluso puedes reducir la cantidad de brillo manteniendo cosas como la saturación de color, los blancos y negros. Asi que no creo que esos videos esten mostrando la realidad del asunto que es que el PT no se nota tanto. De hecho sin usar el PT, lo que más notas, es poner y quitar el HDR. Y tambien se puede conseguir algo aumentado con un brillo mayor a como suelo jugar yo donde en la calibración lo dejo de modo que apenas se vea. Lo cierto es que yo luego meto un perfil de color en el monitor que me resulta más comodo a la vista.

Bueno, a lo tonto y a lo bobo, no iba a jugarlo y ya complete el primer capitulo.

También te digo que a 4k el consumo de Vram se dispara, es normal.

Edito:

DLAA:

DLSS Calidad FG x3

Hay diferencias notables con MSI AB, alguien sabe por qué y cual es el impostor? xD

Subiendo imagenes en resoluciónde 200x100 es básicamente imposible que alguien vea algo xD...

Con la Vram hay que tener en cuenta que hay 2 parametros , allocated y used , la allocated es la que se reserva y la usada es la que en ese momento esta en uso.

Era eso, síJezebeth escribió:@KojimaFC La diferencia que ves sera lo que te comentaba , en el MSI tendrás puesta la reservada y el Doom marca la usada.

Mira por ejemplo acabo de entrar y hacer una screen , fijate que la usada si coincide (practicamente vamos...)

Nomada_Firefox escribió:DLAA te usa una resolución de renderizado mayor, desde 1440p suele ser 1080p, no se en 4k, pero sera algo parecido.

SECHI escribió:Nomada_Firefox escribió:[qu

Lo que no veo que se note mucho, es la mejora del RT. Pueden llamarlo PT o como quieran pero es el juego donde menos he notado cambios. Quizas sea por la paleta de colores usada que practicamente es todo colores muy oscuros. En un juego que pasas el dia corriendo, sin mirar mucho a nada en particular, hay que fijarse mucho para notarlo.

Pues en el analistadebits se ven mucho las diferencias.

https://youtu.be/CoLcpXBYUvc?si=eMoR-Q97UqzTMFJg

Nomada_Firefox escribió:@the_aeon Es una cuestión de gustos pero a mi no me gusta usar el HDR porque las escenas nocturnas acaban siendo diurnas. Me pregunto si el video de arriba del doom era con HDR, eso explicaria muchisimo........

KojimaFC escribió:DLAA:

DLSS Calidad FG x3

Hay diferencias notables con MSI AB, alguien sabe por qué y cual es el impostor? xD

Nomada_Firefox escribió:KojimaFC escribió:DLAA:

DLSS Calidad FG x3

Hay diferencias notables con MSI AB, alguien sabe por qué y cual es el impostor? xD

Pues sí, si que gasta 17 con DLAA, no se que resolución base usara. En 1440p, suele ser 1920x1080. Lo del DLSS calidad, bueno 13. Sube un cacho en 4k, pero es como tu dices porque pasa en más juegos, que el consumo de vram se dispara.

Jezebeth escribió:DLAA: 2560x1440p

Quality: 1707x960p

Balance: 1485x835p

Performance: 1280x720p

Ultra Perf: 853x480p

Nomada_Firefox escribió:Jezebeth escribió:DLAA: 2560x1440p

Quality: 1707x960p

Balance: 1485x835p

Performance: 1280x720p

Ultra Perf: 853x480p

Sera en este juego porque en otros usa 1920x1080p a 1440p el DLAA. Obviamente la nativa no sera siempre igual.

¿Te das cuenta que hay bastante gente a la que no leo por que no lo merecen?

Now, you can enable any DLSS preset, or alternatively customize the resolution scaling between 33% and 100%.

For example, DLSS Super Resolution quality mode uses a 67% input resolution, and DLAA 100%. Users who want increased image quality and some level of performance acceleration, can select “Custom” in NVIDIA app, and pick a value between the two.

On the flip side, Performance mode has an input resolution of 50%, and Ultra Performance 33% - users wanting faster performance, but better image quality, could manually enter 40%. The choice is yours, allowing you to find your perfect balance between image quality and performance on a per game basis.

Nomada_Firefox escribió:Jezebeth escribió:DLAA: 2560x1440p

Quality: 1707x960p

Balance: 1485x835p

Performance: 1280x720p

Ultra Perf: 853x480p

Sera en este juego porque en otros usa 1920x1080p a 1440p el DLAA. Obviamente la nativa no sera siempre igual.

¿Te das cuenta que hay bastante gente a la que no leo por que no lo merecen?

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

![brindis [beer]](/images/smilies/nuevos2/brindando.gif)

roldanpesqui escribió:DLAA stands for Deep Learning Anti-Aliasing. It is an anti-aliasing technique developed by Nvidia that uses AI to improve image quality in video games, specifically by smoothing out jagged edges (aliasing) without changing the game's native resolution. Unlike DLSS (Deep Learning Super Sampling), DLAA focuses on enhancing image quality at native resolution rather than using AI to upscale from a lower resolution]

![facepalm [facepalm]](/images/smilies/facepalm.gif)

Deep Learning Anti-Aliasing provides higher image quality with an AI-based anti-aliasing technique. DLAA uses the same Super Resolution technology developed for DLSS, constructing a more realistic, high-quality image at native resolution.

DLSS Super Resolution boosts performance by using AI to output higher-resolution frames from a lower-resolution input. DLSS samples multiple lower-resolution images and uses motion data and feedback from prior frames to construct high-quality images.

Nomada_Firefox escribió:roldanpesqui escribió:DLAA stands for Deep Learning Anti-Aliasing. It is an anti-aliasing technique developed by Nvidia that uses AI to improve image quality in video games, specifically by smoothing out jagged edges (aliasing) without changing the game's native resolution. Unlike DLSS (Deep Learning Super Sampling), DLAA focuses on enhancing image quality at native resolution rather than using AI to upscale from a lower resolution]

A chat gpt puedes preguntarle en cristiano que te respondera en cristiano.

Y alguno se preguntara por que es mejor no leerle.

dices que tienes una 4070ti y una 5060TI y nunca has comprobado por ti mismo que DLAA es resolución nativa ??? después te extraña que me pensara antes que no has probado el MFG... ,que no tendría nada de malo eh ,pero saltar de esa manera y luego seguir emperrado en que DLAA reescala desde una resolución mas baja... pues ya me hace arquear la ceja.

dices que tienes una 4070ti y una 5060TI y nunca has comprobado por ti mismo que DLAA es resolución nativa ??? después te extraña que me pensara antes que no has probado el MFG... ,que no tendría nada de malo eh ,pero saltar de esa manera y luego seguir emperrado en que DLAA reescala desde una resolución mas baja... pues ya me hace arquear la ceja. Rvilla87 escribió:De locos, el que difunde bulos del tema diciendo que hace bien en no leer a gente que le explica cómo funciona las cosas

Jezebeth escribió:Menuda cabezonería la tuya eh...dices que tienes una 4070ti y una 5060TI y nunca has comprobado por ti mismo que DLAA es resolución nativa ??? después te extraña que me pensara antes que no has probado el MFG... ,que no tendría nada de malo eh ,pero saltar de esa manera y luego seguir emperrado en que DLAA reescala desde una resolución mas baja... pues ya me hace arquear la ceja.

![brindis [beer]](/images/smilies/nuevos2/brindando.gif)

Jezebeth escribió:Menuda cabezonería la tuya eh...dices que tienes una 4070ti y una 5060TI y nunca has comprobado por ti mismo que DLAA es resolución nativa ???

![facepalm [facepalm]](/images/smilies/facepalm.gif)

Nomada_Firefox escribió:Jezebeth escribió:Menuda cabezonería la tuya eh...dices que tienes una 4070ti y una 5060TI y nunca has comprobado por ti mismo que DLAA es resolución nativa ???

Es increible la historia que te estas inventando tu mismo de la nada. Que cabezoneria ni que leches si tu lo has buscao en chatgpt y parece que das por hecho que la nativa es siempre la misma en todos los juegos. Cuando no lo es.......aqui es esa, vale ¿que es que no dije que no sabia que resolución usaba el DLAA en doom the dark ages?

Lo que hay que ver.....

Sigue asi y lo siguiente que hare, sera ponerte en ignorados como a rvilla porque francamente dicho usuario no merece la pena ser leido porque trata a todo el mundo que no piensa como el, como basura.

Me siguen dando lo mismo, 15.300 aproxBorlanchos escribió:1000 puntos me ha bajado el Steel Nomad con los driver 576.80.....

Rvilla87 escribió:Claro que DLAA es 100% resolución, que Nomada_Firefox no se entere (aún siendo un veterano) es lo habitual, no le hagáis mucho caso, pero pensaba que era algo mas conocido en este ámbito. Al menos en el hilo de las 4000 lo era, supongo que por los nuevos usuarios de PC que ha habido recientemente.

Aquí info oficial, para despejar cualquier duda para quien la tuviera: https://www.nvidia.com/en-my/geforce/ne ... e-and-more

También explica lo de que no es solo elegir los presets sino que se puede poner un porcentaje personalizado al gusto:Now, you can enable any DLSS preset, or alternatively customize the resolution scaling between 33% and 100%.

For example, DLSS Super Resolution quality mode uses a 67% input resolution, and DLAA 100%. Users who want increased image quality and some level of performance acceleration, can select “Custom” in NVIDIA app, and pick a value between the two.

On the flip side, Performance mode has an input resolution of 50%, and Ultra Performance 33% - users wanting faster performance, but better image quality, could manually enter 40%. The choice is yours, allowing you to find your perfect balance between image quality and performance on a per game basis.Nomada_Firefox escribió:Jezebeth escribió:DLAA: 2560x1440p

Quality: 1707x960p

Balance: 1485x835p

Performance: 1280x720p

Ultra Perf: 853x480p

Sera en este juego porque en otros usa 1920x1080p a 1440p el DLAA. Obviamente la nativa no sera siempre igual.

¿Te das cuenta que hay bastante gente a la que no leo por que no lo merecen?

De locos, el que difunde bulos del tema diciendo que hace bien en no leer a gente que le explica cómo funciona las cosas

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

NAILIK escribió:

Disculpa @SECHI no vi tu pregunta con tanto lío en los últimos mensajes.

Esta es la aplicación para calibrar el HDR en Windows:

https://www.microsoft.com/store/apps/9N7F2SM5D1LR

Lo único malo es que creo que en W10 no se puede usar. Pruébalo de todas maneras por si acaso

![brindis [beer]](/images/smilies/nuevos2/brindando.gif)

![Ok! [oki]](/images/smilies/net_thumbsup.gif)

![loco [looco]](/images/smilies/nuevos2/borracho.gif)

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

Lorena99 escribió:Bueno pues zotac acaba de confirmar lo que se llevaba meses hablando en reddit. No son los drivers, los pantallazos negros y problemas de señal son problema de arquitectura de la serie 5000:

https://videocardz.com/newz/zotac-relea ... een-issues

La cantidad de valor de reventa que van a perder estas gráficas va a ser histórico.

JR_GAMER escribió:Lorena99 escribió:Bueno pues zotac acaba de confirmar lo que se llevaba meses hablando en reddit. No son los drivers, los pantallazos negros y problemas de señal son problema de arquitectura de la serie 5000:

https://videocardz.com/newz/zotac-relea ... een-issues

La cantidad de valor de reventa que van a perder estas gráficas va a ser histórico.

Para ya de decir estupideces. Cuando van a banear a este personaje?

Lorena99 escribió:Bueno pues zotac acaba de confirmar lo que se llevaba meses hablando en reddit. No son los drivers, los pantallazos negros y problemas de señal son problema de arquitectura de la serie 5000:

https://videocardz.com/newz/zotac-relea ... een-issues

La cantidad de valor de reventa que van a perder estas gráficas va a ser histórico.

KainezIV escribió:Buenas

Me he pillado un PC con la 5070 Ti. El montaje y todo bien a priori. El problema ha venido al empezar a jugar, que me ha empezado a dar flashes la pantalla, tantos completos como solo fragmentos de la pantalla, y parpadeos en negro. Me ocurre incluso en el escritorio y navegando. La frecuencia con la que me ocurre lo hace prácticamente inutilizable. He desactivo el G-Sync y eso parece que lo ha solucionado, pero no he podido usarlo lo suficiente aún.

Por lo que he leído parece ser un problema con los drivers más recientes, pero me quedo mosca de si es por la gráfica. ¿Cómo lo veis?

KainezIV escribió:Buenas

Me he pillado un PC con la 5070 Ti. El montaje y todo bien a priori. El problema ha venido al empezar a jugar, que me ha empezado a dar flashes la pantalla, tantos completos como solo fragmentos de la pantalla, y parpadeos en negro. Me ocurre incluso en el escritorio y navegando. La frecuencia con la que me ocurre lo hace prácticamente inutilizable. He desactivo el G-Sync y eso parece que lo ha solucionado, pero no he podido usarlo lo suficiente aún.

Por lo que he leído parece ser un problema con los drivers más recientes, pero me quedo mosca de si es por la gráfica. ¿Cómo lo veis?

NAILIK escribió:Mientras la gente sepa esto, es mejor rectificarle todos los errores que comete y no enzarzarse en discusiones estériles con alguien que ríe y se burla de quien le corrige solo por no reconocer que la mayoría de veces se equivoca hablando de hardware.

NAILIK escribió:@dunkam82

Sí claro, lo decía por él, pero me refería a que entre todos corrijamos todos los errores/mentiras/desinformaciones que comete a diario para que la gente "novata" no se lleve chascos. Todos sabemos que no se puede debatir nada con él.

Y gracias por tus pruebas de rendimiento con el DLSS, estoy seguro que serán de ayuda a mucha gente. Esto vuelve a desmontar otra de sus mentiras/desinformaciones sobre el MFG x3/MFG x4

KainezIV escribió:Buenas

Me he pillado un PC con la 5070 Ti. El montaje y todo bien a priori. El problema ha venido al empezar a jugar, que me ha empezado a dar flashes la pantalla, tantos completos como solo fragmentos de la pantalla, y parpadeos en negro. Me ocurre incluso en el escritorio y navegando. La frecuencia con la que me ocurre lo hace prácticamente inutilizable. He desactivo el G-Sync y eso parece que lo ha solucionado, pero no he podido usarlo lo suficiente aún.

Por lo que he leído parece ser un problema con los drivers más recientes, pero me quedo mosca de si es por la gráfica. ¿Cómo lo veis?

SECHI escribió:@dunkam82

Es que lo del FrameGen es pura magia negra. No se como coño lo han hecho, pero si tienes una base mas o menos aceptable de frames base (40-50fps) el resto se lo inventa y no notas nada, ya no te digo si los fps base son mas elevados como suelo tener.

Yo intento jugar sobre los 100-120hz (nativo o fg x2) subiendo lo maximo posible los settings porque llegar a 144hz a veces tampoco noto tanta diferencia de fluidez respecto con los 100-120hz. Pero si veo que metiendole un fg x2 o incluso x3 el juego va bien, sin notar artefactos ni lag (juego con mando) se lo activo y arreando.

Hay juegos que lo he configurado hace meses y como me van bien no me meto en los ajustes y no se diferenciar cual tengo fg x2, x3 o esta desactivado.

La gente que dice que no puede con el fg x2 que ve artefactos por todos lados y nota lag que lo hace injugable, de verdad que no lo entiendo. O intentan jugar con una base de 20fps o tienen un monitor sin gsync, freesync o vrr o tienen algun problema de hardware o con el cable displayport o hdmi o lo que sea, porque para mi, es increíble lo bien que funciona el fg.

Y no es efecto placebo, porque a la que quito fg y juego con los fps base (depende del juego pero como maximo lo bajo entre 40-50) se nota al momento. El primer segundo ya notas que no llegas ni a los 60fps. Es activar fg x2 o x3 y notarlo fluido. No solamente un numero en la esquina de la pantalla como muchos dicen. Se nota al instante.

La verdad que no entiendo el hate por esta tecnologia.

Lo unico malo sera de aqui a unos cuantos años cuando los fps minimos no den para mas, pero siempre se puede ir bajando settings de ultra a alto y de alto a medio (siempre hay dos o tres efectos que se comen el 80% del rendimiento), bajar de 4k a 2k etc... y cuando eso ocurra ya habremos cambiado de grafica hace tiempo. Al menos los que estamos en este foro que somos mas o menos entusiastas de este mundillo no os imagino teniendo la 5000 que teneis ahora nueva hasta de aqui 7-8 años.

SECHI escribió:@dunkam82

Es que lo del FrameGen es pura magia negra. No se como coño lo han hecho, pero si tienes una base mas o menos aceptable de frames base (40-50fps) el resto se lo inventa y no notas nada, ya no te digo si los fps base son mas elevados como suelo tener.

Yo intento jugar sobre los 100-120hz (nativo o fg x2) subiendo lo maximo posible los settings porque llegar a 144hz a veces tampoco noto tanta diferencia de fluidez respecto con los 100-120hz. Pero si veo que metiendole un fg x2 o incluso x3 el juego va bien, sin notar artefactos ni lag (juego con mando) se lo activo y arreando.

Hay juegos que lo he configurado hace meses y como me van bien no me meto en los ajustes y no se diferenciar cual tengo fg x2, x3 o esta desactivado.

La gente que dice que no puede con el fg x2 que ve artefactos por todos lados y nota lag que lo hace injugable, de verdad que no lo entiendo. O intentan jugar con una base de 20fps o tienen un monitor sin gsync, freesync o vrr o tienen algun problema de hardware o con el cable displayport o hdmi o lo que sea, porque para mi, es increíble lo bien que funciona el fg.

Y no es efecto placebo, porque a la que quito fg y juego con los fps base (depende del juego pero como maximo lo bajo entre 40-50) se nota al momento. El primer segundo ya notas que no llegas ni a los 60fps. Es activar fg x2 o x3 y notarlo fluido. No solamente un numero en la esquina de la pantalla como muchos dicen. Se nota al instante.

La verdad que no entiendo el hate por esta tecnologia.

Lo unico malo sera de aqui a unos cuantos años cuando los fps minimos no den para mas, pero siempre se puede ir bajando settings de ultra a alto y de alto a medio (siempre hay dos o tres efectos que se comen el 80% del rendimiento), bajar de 4k a 2k etc... y cuando eso ocurra ya habremos cambiado de grafica hace tiempo. Al menos los que estamos en este foro que somos mas o menos entusiastas de este mundillo no os imagino teniendo la 5000 que teneis ahora nueva hasta de aqui 7-8 años.

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

leonigsxr1000 escribió:Mi TEORIA (que no tiene porque ser la acertada) es que el EDID (comunicación de pantalla y fuente) se lleva mejor con unas pantallas que otras y con unos cables que otros.....lo que tengo claro es que NO es culpa de las graficas eso lo digo al 99%

También otra teoria que tengo es que tengo en la habitación 2 OLED de 65" , 2 PCs , router, 4 consolas y muuuuuchos cables y regletas, puede ser algo de energía residual que no se filtra no se (ese tema lo desconozco)

Mis flases eran exactamente como los del video pero la verdad muy aleatorios como he dicho antes.

Espero haberte ayudado

https://www.reddit.com/r/pcmasterrace/c ... lashes_on/

Lo primero que puedes hacer para no comerte la cabeza es probar un cable de fibra certificado, intenta que sea lo mas corto posible (si es de 3 metros mejor que mejor) aunque el mio es de 5 y funciona bien

)

)

dunkam82 escribió:... cuando me he puesto a probarlo, haciendo giros bruscos de cámara, ataques en todas direcciones y yo veía que eso iba como un tiro con una fluidez acojonante sin absolutamente nada de imput lag, he parado el juego para comprobar si estaban puestos los ajustes o se me había olvidado guardar y si estaban puestos. De hecho he cerrado el juego y he vuelto a iniciar y seguía siendo la misma experiencia maravillosa.

Yo tampoco entiendo tanto hate con esa tecnología cuando funciona tan bien.

![enrojecido [ayay]](/images/smilies/nuevos/sonrojado_ani1.gif)

![brindis [beer]](/images/smilies/nuevos2/brindando.gif)

)

)