papatuelo escribió:nanoxxl escribió:

May 21st 2013 at 2:00 pm"The box will pop on and come to your home page or wherever you were last. In order to do that in an efficient way, you have to architect all of that into the box up front. A lot of it is in the SoC," Holmdahl says. That SoC contains both the CPU and GPU, as well as embedded ESRAM; the first two components are based on an AMD design, and custom-built into an SoC with that embedded memory. That CPU is based on the Jaguar design from AMD, with eight cores and a 4MB L2 cache, while the GPU is of the D3D11.1 (with extensions) variety, Baker tells us.

????????????

Eso digo yo.

????????

Con lo único que te quedas es que si la consola se enciende con el comando XBOX ON, se te redirige a lo estuvieras haciendo cuando la apagaste???

O lo dices por lo de que la GPU es 11.1???

Si quieres te dicen en 2013 que están trabajando en una GPU DX12 cuando DX12 no se hizo público hasta 2014... Y de todas formas, por supuesto que no se sabe ni esta confirmado si es full DX12.

Por otro lado ahí tienes el test ray tracing con el que presentaron dicha características de DX12 en la GDC, afirmando que se trataba de una demo antigua de XBOX ONE.

nanoxxl escribió:Sigo sin entender que quieres decir con ese enlaze ? Que demuestra ? Con lo viejo que es

josemurcia escribió:Que pesados con el ray-tracing. No lo váis a ver en ningún juego, solo es una demo técnica. Pero ni en PC hasta dentro de bastante tiempo.

josemurcia escribió:Repetir una y otra vez que hay una demo de Ray-Tracing para ONE no es aportar información.

Pero si es que es de cajón. En 2012 Epic presentó SVOGI, una técnica de iluminación global basada en voxels menos pesada que el ray-tracing, hasta el momento sigue siendo la mejor solución para iluminación global que se puede ejecutar en tiempo real en hardware actual.

http://on-demand.gputechconf.com/gtc/20 ... nation.pdf

Un año después dijeron que las nuevas consolas no podrían mover SVOGI, así que no tenían más remedio que quitarla y se pusieron a investigar otra solución de iluminación global para la nueva generación más ligera y menos precisa que pudiese funcionar en consolas.

Actualmente UE4 tiene en beta 3 soluciones distintas de iluminación global.

- La VXGI exclusiva de Maxwell, la más precisa que se ha visto después de SVOGI, también basada en voxels y menos pesada que ray-tracing.

- La suya propia, Distant Field Global Illumination, muy ligera y muy eficiente, en teoría es una mezcla de varias técnicas y la añadirán en la próxima versión, la 4.8. Mucho menos precisa que las basadas en voxels.

- La GI de Lionhead para Fable Legends, basada en light propagation volumes, también bastante ligera y también mucho menos precisa que las basadas en voxels.

Así que me estás intentando decir, que por arte de magia ONE va a poder mover en juegos un tipo de iluminación mucho más precisa y que necesita mucha más potencia que todas las alternativas que hay ahora, cuando ni PS4 ni ONE han podido con SVOGI que es menos pesada que ray-tracing. Y teniendo en cuenta que no hemos visto ray-tracing en tiempo real más allá de demos ni en hardware potente de PC.

Apliquemos el sentido común.

argam escribió:No habeis mirado la presentacion que se puso un poco mas atras aqui sobre el desarrollo de The tomorrow children? esa gente esta utilizando cascaded-voxel-cone-tracing.

El link: http://www.dualshockers.com/2014/09/03/ ... reenshots/

Un saludo!

David Ricardo escribió:Un par de quotes del año pasado de Phil Spencer al respecto. De marzo y de pctubre respectivamente, si no me equivoco.DX12 will have impact on XBOX One games written for DX12. Some DX12 features are already in XBOX One but full DX12 coming.

https://twitter.com/XboxP3/status/446873135594225664?s=17“On the DX12 question, I was asked early on by people if DX12 is gonna dramatically change the graphics capabilities of Xbox One and I said it wouldn’t. I’m not trying to rain on anybody’s parade, but the CPU, GPU and memory that are on Xbox One don’t change when you go to DX12. DX12 makes it easier to do some of the things that Xbox One’s good at, which will be nice and you’ll see improvement in games that use DX12, but people ask me if it’s gonna be dramatic and I think I answered no at the time and I’ll say the same thing.”

http://wccftech.com/phil-spencer-directx-1-xbox-one-hardware-graphics/

Pada escribió:Pero vamos, el río suena... eso es impepinable.

Brigade use NVIDIA and AMD hardware to do path tracing on the GPU. All rendering kernels are fine-tuned for every card to give maximum performance combined with special scene-graph optimizations that are unique to Brigade, allows us to bring real-time path tracing to video games. Instancing is one of the most powerful features of Brigade. It allows you to instance any kind of mesh you want. (Trees, grass, cars for heavy traffic in cities, etc…) It’s up to you ! Performance wise, each instance is the same loss as rendering one single triangle. Because Brigade uses a very specific custom acceleration structure, It can create multi-million or even billion polygons scenes without a sweat. Brigade also supports animation for bones (with skinning), cameras, objects & more using COLLADA files.

Rich post-effect pipeline including high-quality bloom, white balance, color grading, saturation/contrast, bleach bypass, noise reduction filters and more… Brigade has everything you need to set the mood & recreate the imperfections of a camera lens. Brigade supports HDRI lighting and contains a customizable physical sky. HDRI can cast soft shadows if they contain any bright light source. The physical sky is doing atmospheric scattering depending on multiple factors like the sun position. Using a complex BRDF, Brigade is capable of creating any kind of material possible using a “mega-material”. Anything you want is possible using our very flexible material pipeline. Change the IOR, glossiness and the reflection of the material in real-time.

La dispersión de Rayleigh (en honor a Lord Rayleigh) es la dispersión de la luz visible o cualquier otra radiación electromagnética por partículas cuyo tamaño es mucho menor que la longitud de onda de los fotones dispersados. Ocurre cuando la luz viaja por sólidos y líquidos transparentes, pero se ve con mayor frecuencia en los gases. La dispersión de Rayleigh de la luz solar en la atmósfera es la principal razón de que el cielo se vea azul.

Killzone 4 Uses Raytracing For Its Real-Time Reflections

The Tomorrow Children uses a new lighting technology named Cascaded Voxel Cone Ray Tracing, which allows to simulate lighting in real time, and uses actual real reflections, and not screen space reflections like most games.

darksch escribió:Cone Tracing es un derivado de Ray Tracing. El ray-tracing tal cual es difícil que se use porque según parece crea excesivo aliasing, por eso siempre hay que activar un AA bastante lento en los programas que renderizan con ray-tracing. Podéis comprobarlo vosotros mismos, entre activarlo y desactivarlo hay un mundo de diferencia en tiempo de render.

http://en.wikipedia.org/wiki/Cone_tracing

Aquí un poco más.

http://www.geeks3d.com/20121214/voxel-cone-tracing-global-illumination-in-opengl-4-3/

Mi pregunta es, y viendo el uso del async en el Tomorrow Children, ¿hay que usar shaders de render, y no de computación?. Porque si seguimos cargando todo en los mismos sin posibilidad de paralelización no estamos haciendo nada, seguimos retrasando el frame.

Yo me esperaba que al ser algo tipo voxel pudiera realizarse mediante computación, usando parámetros que no requirieran el hardware de render (como texturas) para poder computarlo y no renderizarlo. Es decir el resultado tiene que ir a un RT, pero eso requiere muy poco uso del hardware de render, lo importante que es su cálculo poder hacerlo sólo mediante computación.

Nuhar escribió:Lo que llamas ruido es por los cálculos preliminares que hace al renderizar, realmente es una fase previa al renderizado.

chris76 escribió:Josemurcia,lo mas parecido a un juego con raytracing no es la demo del engine que nombras,es el tomorrow children como podemos apreciar,la iluminacion es de escandalo pero a cambio de graficos muy vacios,todo no puede ser..

Respecto a la iluminacion en consolas,no me digais porque, pero e tenido xbox/ps2,360/ps3 y one/ps4 y sony no se que hace pero sus juegos exclusivos siempre siempre siempre tienen una iluminacion mucho mas fotografica,algo tiene sus apis que almenos en esto lo clava

josemurcia escribió:Nuhar escribió:Lo que llamas ruido es por los cálculos preliminares que hace al renderizar, realmente es una fase previa al renderizado.

No, el ruido existe desde que comienza a renderizarse hasta que tu consideres que el ruido se ha reducido lo suficiente como para detenerlo. Cuanto más tiempo, más rayos, más muestras, menos ruido.

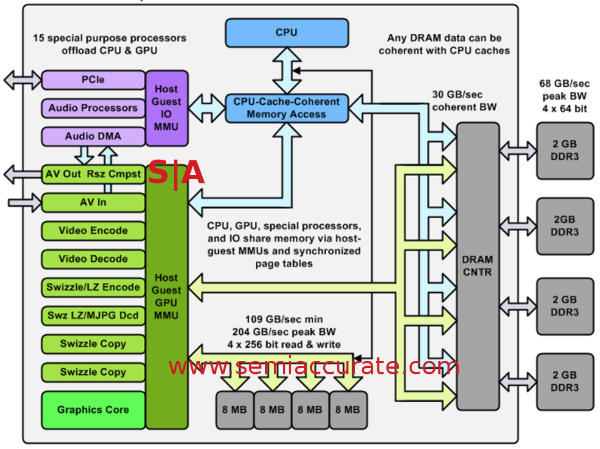

In the GpuMmu model, the graphics processing unit (GPU) has its own memory management unit (MMU) which translates per-process GPU virtual addresses to physical addresses.

Each process has separate CPU and GPU virtual address spaces that use distinct page tables. The video memory manager manages the GPU virtual address space of all processes and is in charge of allocating, growing, updating, ensuring residency and freeing page tables. The hardware format of the page tables, used by the GPU MMU, is unknown to the video memory manager and is abstracted through device driver interfaces (DDIs). The abstraction supports a multilevel level translation, including a fixed size page table and a resizable root page table.

Although the video memory manager is responsible for managing the GPU virtual address space and its underlying page tables, the video memory manager doesn’t automatically assign GPU virtual addresses to allocations. This responsibility falls onto the user mode driver.

.png)

Nick Baker

: There was lot of bitty stuff to do. We had to make sure that the whole system was capable of virtualisation, making sure everything had page tables, the IO had everything associated with them. Virtualised interrupts.... It's a case of making sure the IP we integrated into the chip played well within the system. Andrew?

Andrew Goossen

:..................Nick talked about the page tables. Some of the new things we have done - the GPU does have two layers of page tables for virtualisation. I think this is actually the first big consumer application of a GPU that's running virtualised.

........................ Our memory manager on game title side is completely rewritten. We did that to ensure that our virtual addressing for the CPU and GPU are actually the same when you're on that side. Keeping the virtual addresses the same for both CPU and GPU allows the GPU and CPU to share pointers. For example, a shared virtual address space along with coherent memory along with eliminating demand paging means the GPU can directly traverse CPU data structures such as linked lists.

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif) .

.![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif) .

.Direct3D 12 allocates video memory in pages, the size of which is determined by the heap properties. Different types of resources might use different page sizes. If a resource heap might need to contain a number of resources of different page sizes, then the heap should be aligned to the largest page size of the relevant resources.

eloskuro escribió:----

Y de regalo la tecnica de forza horizon 2 (que tmb es diferente al ray tracing, ojo xD)

https://www.youtube.com/watch?v=eMkgjPyLA0M

eloskuro escribió:----

Y de regalo la tecnica de forza horizon 2 (que tmb es diferente al ray tracing, ojo xD)

https://www.youtube.com/watch?v=eMkgjPyLA0M

argam escribió:eloskuro escribió:----

Y de regalo la tecnica de forza horizon 2 (que tmb es diferente al ray tracing, ojo xD)

https://www.youtube.com/watch?v=eMkgjPyLA0M

Pregunta para los que saben del tema. Porque las sombras (de los edificios sobre todo) se mueven "a saltos" cuando los coches y otras cosas se mueven de forma mas fluida?

Un saludo!

Gaiden escribió:Esas sombras (de los edificios) no son dinámicas @eloskuro, una sombra dinámica no puede ir a saltos pq se genera respecto al foco de iluminación. Esas están scriptadas con la hora del día con una posición predefinida.

Sombras dinámicas Skyrim: https://www.youtube.com/watch?v=fk4AOQwa_Tc

gta IV: https://www.youtube.com/watch?v=dZlBLyNXbJ4