fonso866 escribió:A mi lo que me encanta es que se siga defendiendo cosas que el propio Jensen Juan o los de Digital Foundry han tenido que decir que se han pasado de frenada y se lo habrían tenido que mirar.

Se te olvida mencionar que eso ha sido fruto de la presión mediática, donde uno de los de digital foundry ha dicho literalmente que le han llegado mensajes de amenazas de muerte, así que ya dirás, si te ponen un cuchillo en el cuello o te dicen miles de personas que te van a lanzar piedras pues igual como que por coacción reculas y ajustas el argumentario para que no te hagan daño.

https://x.com/Septic_Sauce/status/20342 ... 90136?s=20Pero es por miedo, no es algo honesto.

fonso866 escribió:También que estamos ante el primer caso de la historia en donde se presenta una tecnología que no se maquilla (pun intended) al extremo para que parezca mas de lo que realmente luego va a ser. La casualidad que han presentado algo que es peor que luego el producto final. Una tecnologica siendo honesta? No pensaba que mis ojos verían eso.

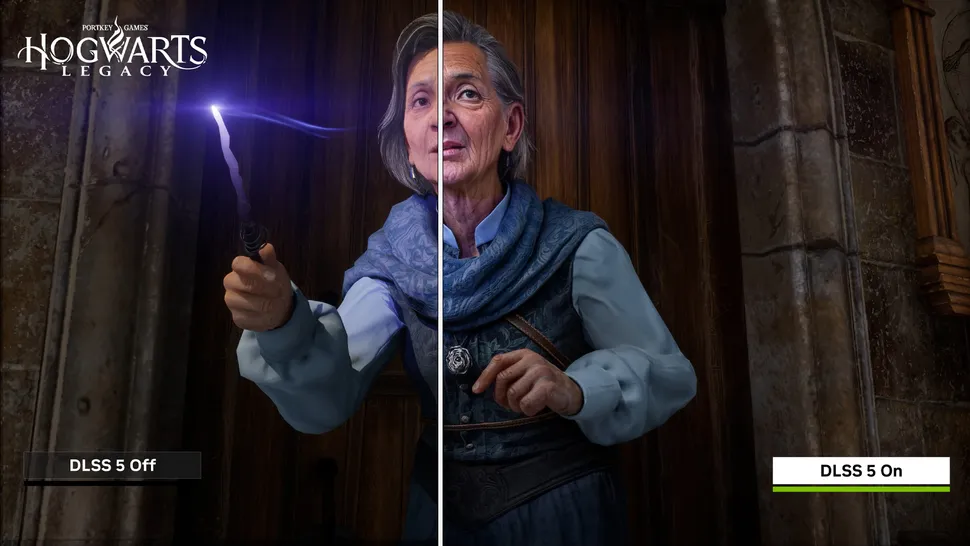

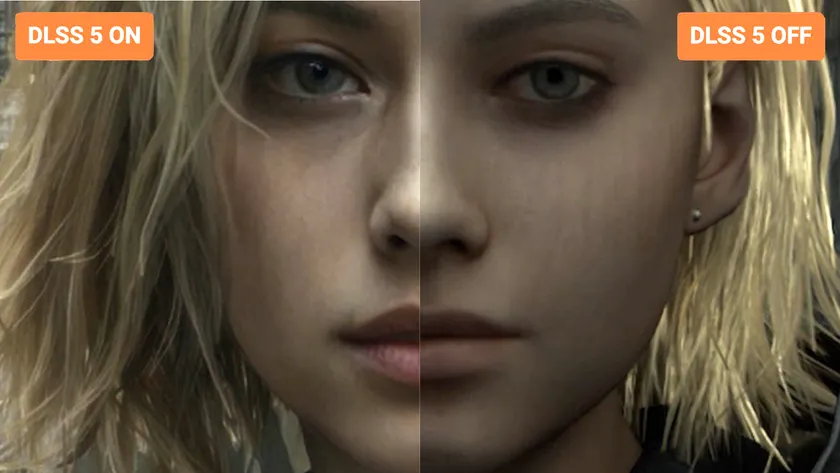

Yo creo que si se ha maquillado, de hecho que no se haya mostrado aún un gameplay extenso es una muestra de ello, casi todo lo que se ha visto son secuencias totalmente controladas, y lo poco que se ha visto fuera de ese control es un vídeo de un chaval que ha filtrado un gameplay en YouTube de la GTC sobre starfield, que por cierto, con una calidad bastante justa, el vídeo, así que si, lo han maquillado, o lo han mostrado en bandeja de plata, como quieras llamarlo, de hecho hasta DF ha mostrado lo mismo de la misma forma, escenas cortas y sin movimiento.

fonso866 escribió:Que por otra parte, 10/10 para los de marketing, que han logrado hacer calar un mensaje que incluso no compran los que lo han creado y difundido.

Esto se ha hecho con el apoyo de varias empresas de videojuegos, desde con comunicados hasta con vídeos, no ha sido NVIDIA que ha agarrado y por la cara lo ha implementado en los juegos que ha querido, esto ha ido de la mano de acuerdos con estas empresas que han accedido y han mostrado su admiración y apoyo por la tecnología.

Y si no hubiera sido así NVIDIA podría haberlo hecho igual, es una tecnología más, no tiene que pedir permiso a nadie por un efecto de postprocesado, igual que no pide permiso por RTX REMIX, o por los filtros de nvidia freestyle.

Repito, aquí se juntan varias cosas, por una parte están los ANTI IA, que suelen ser bastantes en el mundo del desarrollo, por motivos ideológicos, no hay más que ver que muchos de ellos llevaban el tema de los pronombres en twitter y hubo una época donde parecía que si no lo tenían puesto en su biografía que no les contrataban, bastante sectario por cierto y a mi me pareció bastante impactante la moda, ahora no sé si es porque muchos migraron a BS o porque ya pasó un poco, pero no se ve tanto ya; lo que si se ve más ahora es ese odio desmedido por la IA, que no deja de ser miedo a perder la faena, parecido al movimiento Ludita, que se lleva cociendo desde hace mucho tiempo, miedo a ser sustituidos. Generalmente son los que tienen el pensamiento catastrofista, de que los juegos serán todos homogenizados, de que NVIDIA acabará con los juegos, la industria ya será destruida y perderá el sentido, algo parecido ya he dicho que ha pasado con UE5, hace mucho que se dice que UE5 es una basura, que acabará con la industria, se ven vídeos por internet, bastantes, no de gente de esta rama ideológica, suelen ser más gamers, porque hay ciertas corrientes ideológicas que mueven estas ideas, luego miras que juego ganó el GOTY en el 2025 y con premios a mejor dirección de arte y se acaba la tontería. Y precisamente con UE5 también se habla de la homogenización del arte, más por parte de gente que solo juega a juegos, los desarrolladores por contra no tienen esa mentalidad como si les ocurre con la IA, porque forma parte de la lucha contra EPIC, que se ha convertido como una especie de niño apestado para muchos.

Por otra parte tienes a los jugadores que siempre han peleado por sus sistemas, por ver si su sistema tiene los mejores gráficos, contando pelos de la barba, la calidad de las rocas, mi juego tiene mejores texturas, mi juego tiene los mejores gráficos, etc... y cuando han visto que un cutre juego de Bethesda de la nada tiene ese aspecto visual el cerebro les ha hecho crack, ya se han acabado sus batallitas en twitter, que muchos viven de ello, ganan pasta literalmente, ya no tienen sentido, y no te hablo de un Sasel, hasta uno que hace contenido de Rockstar y que hace comparaciones visuales entre juegos de Rockstar y otros, como ocurre ahora con Crimson Desert, sabe que peligra su forma de pensar, es como si les quitas el sentido de vivir a esas personas, de pelear.

Piensa que estas últimas décadas casi todo ha sido pelear por los gráficos, casi todo lo que se ha empujado ha sido por eso, salen GPUs nuevas cada dos años para mejorar eso, lo mismo con las consolas; Nintendo es la principal azotada donde se le lleva mucho tiempo recriminando que están muy atrás, que hacen juegos que parecen de la Wii, etc... así que es una realidad que se ha roto en manos de muchos de ellos, donde el impacto no les deja asimilar ese cambio. Si te fijas muchos han salido sacando pecho de Death Stranding 2

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

¡Yo no necesito eso, ya tengo a mi Kojima! ¡Mira como mi Kojima hace fotorealismo, parece la realidad! ¡No hay nadie que sea vea igual en otro juego como mi Norman Reedus en DS2! ¡Pero tiene que ser mi amado Kojima! ¡Nadie más puede!

Me jugaría algo a que con el tiempo esto se va a asimilar a medida que sea accesible para más gente, cuando sea posible para hardware más modesto la gente lo probará y seguramente dirá "Pues no está tan mal, la verdad". Pero como digo, y como dije con la predicción de esto, el tiempo lo dirá, ha pasado con muchas cosas a lo largo de la historia, pasó con la Torre Eiffel, que se decía que era un trozo de hierro feo y que estropeaba París, luego se convirtió en la maravilla del mundo, pasó con el Rock, pasó hasta con el mismo DLSS1 pero sin tanto odio porque no era algo tan disruptivo, DLSS1 no trajo el techo gráfico, los hilos cíclicos de toda la vida han sido siempre sobre el techo gráfico, cuando se conseguirá, peleas entre sistemas por ver quien tiene los juegos que se ven mejor.

https://i.imgur.com/jQXNrdq.pngEn fin, como digo, el tiempo siempre lo dirá, yo aunque vaya contracorriente pienso así, no me voy a dejar comer la cabeza por la masa, entiendo la situación de crispación y soy consiente de que ha habido mucho rechazo, y en gran parte creo que ha sido desmedido por algo que es 100% opcional y elitista, lo hubiera entendido si nos hubieran dicho que a partir de ahora todo pasa por ahí y te tienes que encima comprar una GPU de 4000 euros, pero no es así ni de lejos, es una tecnología regalada opcional. Creo que realmente se aceptará con el tiempo porque traerá más beneficios que otra cosa, la tecnología en si, ya que esto es solo el principio de una tecnología que terminará pasando a los motores gráficos, y también soy conscientes que muchas veces cuando aparecen innovaciones estas se rechazan por la sociedad pero luego terminan siendo asimiladas positivamente porque mejoran y facilitan la producción, hacen que cosas que antes resultaban muy complejas sean más accesibles y no se tenga que perder tanto tiempo en tareas que antes exigían mucho más tiempo y recursos, no es algo nuevo, a la larga NVIDIA y el resto de GPUs solo facilitarán los aceleradores de IA y esto será algo natural fuera de su ecosistema incorporado en software third, no será una función exclusiva.

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

![Que me parto! [qmparto]](/images/smilies/net_quemeparto.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![facepalm [facepalm]](/images/smilies/facepalm.gif)

![disimulando [fiu]](/images/smilies/fiu.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif) ¡Yo no necesito eso, ya tengo a mi Kojima! ¡Mira como mi Kojima hace fotorealismo, parece la realidad! ¡No hay nadie que sea vea igual en otro juego como mi Norman Reedus en DS2! ¡Pero tiene que ser mi amado Kojima! ¡Nadie más puede!

¡Yo no necesito eso, ya tengo a mi Kojima! ¡Mira como mi Kojima hace fotorealismo, parece la realidad! ¡No hay nadie que sea vea igual en otro juego como mi Norman Reedus en DS2! ¡Pero tiene que ser mi amado Kojima! ¡Nadie más puede!