f5inet escribió:malosoxxx escribió:f5inet escribió:DX12 requiere un controlador grafico WDDM 2.0 que viene con Windows 10. Xbox ONE no tiene 'aun' Windows 10, luego aun no dispone del controlador grafico, luego aun no soporta DX12.

¿No iba el SO incluido en el juego?

Si, y Windows 10 para XboxONE aun esta en beta, y un juego no va a salir al mercado con un SO/SDK en beta.

@morepawer no se si estas de cachondeo o lo dices en serio, pero por si acaso...

¿y quien carajos es el tal Johan Anderson?

https://twitter.com/repi?ref_src=twsrc%5Etfw

El director tecnico del motor Frostbite de EA

![enamorados [inlove]](/images/smilies/nuevos2/enamoraos.gif)

papatuelo escribió:

Excelente

eloskuro escribió:No. Lo que abren es la posibilidad a los DEVS a que usen estas tecnicas.

Cada juego tienen que hacerlo con estas tecnicas en mente para que la XBO de todo su potencial. No vamos a ver boost tremendos en juegos no pensados para estos menesteres.

En 2016 y 2017 iremos viendo como la consola va a ir dando la talla graficamente en bastantes multiplataforma y veremos como los juegos first haran cosas que antes nos parecian imposibles.

Sulei escribió:eloskuro escribió:No. Lo que abren es la posibilidad a los DEVS a que usen estas tecnicas.

Cada juego tienen que hacerlo con estas tecnicas en mente para que la XBO de todo su potencial. No vamos a ver boost tremendos en juegos no pensados para estos menesteres.

En 2016 y 2017 iremos viendo como la consola va a ir dando la talla graficamente en bastantes multiplataforma y veremos como los juegos first haran cosas que antes nos parecian imposibles.

Genia entonces.

Yo pensaba que igual con el nuevo dash se liberaba más RAM para juegos y quizás por eso iría más «suelta»

Saludos.

eloskuro escribió:Al ser un SO más rapido y mas liviano puede que hayan liberado algo de ram, pero no se sabe. De todas formas no espereis que liberen gigas de ram ^^ U , liberarian unos cuantos megas

![como la niña del exorcista [360º]](/images/smilies/nuevos/vueltas.gif)

Cyborg_Ninja escribió:Me gustaria compartir algo con vosotros y abrir un debate. No es de hardware pero si de software y la desinformacion que puede haber debido a los posteriores parches, tanto de una plataforma como u otra, prestad atencion.

¿Os acordais del analisis de MGSV por parte de Digital Foundry? pues bien, ahi se señalaba que MGSV en PS4 utilizaba una tecnica llamada Subsurface Scattering para algunos primeros planos de los rostros, y ponian estas imagenes comparativas:

Si os fijais es cierto que en PS4 se utiliza y en One/PS3/360 no (aunque el modelado de One era 1:1 respecto al de PS4, a diferencia de los sistemas de la generacion anterior), las imagenes doy fe de que son ciertas y nada manipuladas, yo las veia asi y lo notaba.

El problema? que despues del parche que añadia el online, me di cuenta de que algo veia diferente... y es que mirad las capturas que saque yo mismo de mi Xbox One (lo podeis comprobar en GameDVR).

Esta de PS4...

Xbox One (actual)

PS4:

Asi es, aplicaron Subsurface Scattering en la version de Xbox One. De hecho era precisamente en esos momentos donde Xbox One tenia ventaja en el framerate y por eso algunos nos extraño su ausencia cuando iba mas sobrada de rendimiento. En el subforo de multi habia quienes decian tonterias del tipo que era debido a que habian subido la resolucion etc. En todos esos primeros planos ya son versiones 1:1.

Las imagenes como digo son 100% reales y lo teneis tan facil como comprobarlo con videos del lanzamiento del juego (Septiembre) y compararlo con los de Octubre. Y no hay ni una sola fuente que se haya hecho eco de ello. Obviamente tiene sentido, DF no va a estar todo el dia analizando los mismos juegos a cada parche, lo que quiero decir con esto es que a saber cuantos juegos han cambiado en X detalles y ni dios se ha enterado. En este caso pues te informas y lees que en PS4 (y PC, en la comparativa de PS4 vs PC vs XBO tambien se señalaba) utiliza SSS y en One no, cuando la realidad es bien diferente y es que se trato simplemente de algo que estaba por añadir en One.

eloskuro escribió:Al ser un SO más rapido y mas liviano puede que hayan liberado algo de ram, pero no se sabe. De todas formas no espereis que liberen gigas de ram ^^ U , liberarian unos cuantos megas

darksch escribió:El host OS (con hipervisor) ocuparía más o menos unos 500MB imagino, y tened en cuenta que en la consola no hay swap. Acordaros que el SO de WiiU, con lo escaso que es, ocupa 1GB en estas condiciones. No veo raro que se reserve 3GB para todo lo que no sean juegos. A mí me gusta así, darle preferencia a un sistema versátil que tener unos cuantos MB extras para algunas texturas que al fin y al cabo o no lo vas a notar o no los van a usar, visto lo visto. Darle espacio extra al SO de juegos es peligroso, porque no hay vuelta atrás, no puedes volver a quitárselos.

AKR escribió:darksch escribió:El host OS (con hipervisor) ocuparía más o menos unos 500MB imagino, y tened en cuenta que en la consola no hay swap. Acordaros que el SO de WiiU, con lo escaso que es, ocupa 1GB en estas condiciones. No veo raro que se reserve 3GB para todo lo que no sean juegos. A mí me gusta así, darle preferencia a un sistema versátil que tener unos cuantos MB extras para algunas texturas que al fin y al cabo o no lo vas a notar o no los van a usar, visto lo visto. Darle espacio extra al SO de juegos es peligroso, porque no hay vuelta atrás, no puedes volver a quitárselos.

Yo creo que 2GB de ram es mas que suficiente para cualquier sistema operativo, mas que nada porque lo que mas recursos ocupa en un sistema son el resto de aplicaciones, navegador, paquetes ofimaticos, aplicaciones diseño u otras y juegos. El sistema en si con 2gb o menos deberia ir perfecto, cuando necesite mas sera precisamente cuando no estamos jugando (viendo una pelicula por ejemplo o haciendo navegacion web) con lo cual tendria disponible la ram que no usan los juegos.

![muy furioso [+furioso]](/images/smilies/nuevos/furioso.gif) ). Como dije, prefiero versatilidad. Total si luego la RAM no saben ni en que usarla (se sigue usando streaming de datos en los juegos) o no se notaría (no hay ancho/potencia para gestionar tantos GB por fotograma en pantalla).

). Como dije, prefiero versatilidad. Total si luego la RAM no saben ni en que usarla (se sigue usando streaming de datos en los juegos) o no se notaría (no hay ancho/potencia para gestionar tantos GB por fotograma en pantalla). darksch escribió:Darle espacio extra al SO de juegos es peligroso, porque no hay vuelta atrás, no puedes volver a quitárselos.

cercata escribió:Y lo de para que usar la RAM, pues por ejemplo en Fallout 4 para tener todas las armas cargadas en memoria siempre, y que no haya tirones al cambiar de arma. Por poner un ejemplo.

To facilitate this, in addition to asynchronous compute queues, the Xbox One hardware supports two concurrent render pipes. The two render pipes can allow the hardware to render title content at high priority while concurrently rendering system content at low priority. The GPU hardware scheduler is designed to maximise throughput and automatically fills "holes" in the high-priority processing. This can allow the system rendering to make use of the ROPs for fill, for example, while the title is simultaneously doing synchronous compute operations on the Compute Units.

Andrew Goossen: The number of asynchronous compute queues provided by the ACEs doesn't affect the amount of bandwidth or number of effective FLOPs or any other performance metrics of the GPU. Rather, it dictates the number of simultaneous hardware "contexts" that the GPU's hardware scheduler can operate on any one time. You can think of these as analogous to CPU software threads - they are logical threads of execution that share the GPU hardware. Having more of them doesn't necessarily improve the actual throughput of the system - indeed, just like a program running on the CPU, too many concurrent threads can make aggregate effective performance worse due to thrashing. We believe that the 16 queues afforded by our two ACEs are quite sufficient.

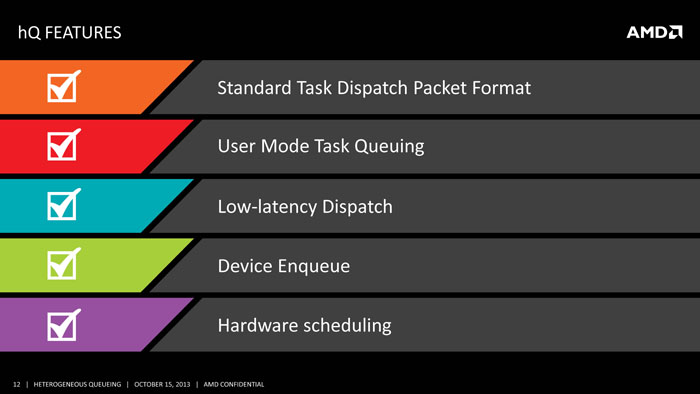

The next step in the HSA is the “heterogeneous queuing” or hQ. HSA devices communicate with one another using queues. Traditionally, CPU is the central task manager where a command from the software goes to the CPU and then it dispatch queue to other hardware and components like GPU in the PC. If a workload is designed for GPU, it must first go to CPU and then the CPU dispatches the work to the GPU through OS service or “kernel mode” transition. Then the kernel driver translates task packet to the vendor specific format.

Since AMD HSA is an open standard. The HSA queuing language will be open to any software engineers. It employees standard packet format where the application directly generates standard packet that are placed in queues. The packet gets to send to the hardware directly where the hardware then execute it. The packet has pointer to instruction code, resource allocation in order to run the compute kernel. The oepn standard means that it will support by all HSA-compatible hardware and eliminate the need for vendor specific code. For AMD APU, the hardware scheduler moved to the GPU itself to eliminate the need for the kernel.

papatuelo escribió:¿Os acordaís de que supuestamente XBOX tiene solo dos ACEs pero que en lugar de manejar los ocho hilos por ACE que es lo normal en GCN maneja 16?

Pues mirad la Fury.

En lugar de llevar 8 como sus hermans de generaciones anteriores lleva solo 4. La mitad, y supongo que rendirá cada una el doble.

Asi que tenemos 4 Aces y 2 HWS (Hardware Scheduler)

Digital Foundry:

Digital Foundry: the complete Xbox One architects interviewTo facilitate this, in addition to asynchronous compute queues, the Xbox One hardware supports two concurrent render pipes. The two render pipes can allow the hardware to render title content at high priority while concurrently rendering system content at low priority. The GPU hardware scheduler is designed to maximise throughput and automatically fills "holes" in the high-priority processing. This can allow the system rendering to make use of the ROPs for fill, for example, while the title is simultaneously doing synchronous compute operations on the Compute Units.Andrew Goossen: The number of asynchronous compute queues provided by the ACEs doesn't affect the amount of bandwidth or number of effective FLOPs or any other performance metrics of the GPU. Rather, it dictates the number of simultaneous hardware "contexts" that the GPU's hardware scheduler can operate on any one time. You can think of these as analogous to CPU software threads - they are logical threads of execution that share the GPU hardware. Having more of them doesn't necessarily improve the actual throughput of the system - indeed, just like a program running on the CPU, too many concurrent threads can make aggregate effective performance worse due to thrashing. We believe that the 16 queues afforded by our two ACEs are quite sufficient.

Seguimos:The next step in the HSA is the “heterogeneous queuing” or hQ. HSA devices communicate with one another using queues. Traditionally, CPU is the central task manager where a command from the software goes to the CPU and then it dispatch queue to other hardware and components like GPU in the PC. If a workload is designed for GPU, it must first go to CPU and then the CPU dispatches the work to the GPU through OS service or “kernel mode” transition. Then the kernel driver translates task packet to the vendor specific format.Since AMD HSA is an open standard. The HSA queuing language will be open to any software engineers. It employees standard packet format where the application directly generates standard packet that are placed in queues. The packet gets to send to the hardware directly where the hardware then execute it. The packet has pointer to instruction code, resource allocation in order to run the compute kernel. The oepn standard means that it will support by all HSA-compatible hardware and eliminate the need for vendor specific code. For AMD APU, the hardware scheduler moved to the GPU itself to eliminate the need for the kernel.

cercata escribió:Y eso del hQ, en que beneficios se traduce al final en los juegos ?

Horizonte de sucesos escribió:La Ram para el Shared OS no la van a tocar porque no es necesario actualmente. Y cuando los juegos vayan aumentando los requisitos de RAM ya podrán usar los 4GB de HBM que hay en el SOC.

![uzi [uzi]](/images/smilies/nuevos2/uzi.gif)

LuiTrO escribió:Horizonte de sucesos escribió:La Ram para el Shared OS no la van a tocar porque no es necesario actualmente. Y cuando los juegos vayan aumentando los requisitos de RAM ya podrán usar los 4GB de HBM que hay en el SOC.

Xbox one tiene 4gb de HBM?![uzi [uzi]](/images/smilies/nuevos2/uzi.gif)

Pero si esta memoria acaba de salir en la serie fury. Está confirmado oficialmente?

Estaríamos hablando de 8gb ddr3 + 4hbm?

Wtf?

argam escribió:LuiTrO escribió:Horizonte de sucesos escribió:La Ram para el Shared OS no la van a tocar porque no es necesario actualmente. Y cuando los juegos vayan aumentando los requisitos de RAM ya podrán usar los 4GB de HBM que hay en el SOC.

Xbox one tiene 4gb de HBM?![uzi [uzi]](/images/smilies/nuevos2/uzi.gif)

Pero si esta memoria acaba de salir en la serie fury. Está confirmado oficialmente?

Estaríamos hablando de 8gb ddr3 + 4hbm?

Wtf?

Seria ridiculo tener un banco de memoria RAM de 4GB ahi muerto de risa. Pero claro, cada uno puede creer lo que quiera...

SK Hynix H5TQ4G63AFR 4 Gb (512 MB) DDR3 SDRAM (total of 16 x 512 MB = 8 GB)

legna82 escribió:argam escribió:LuiTrO escribió:Xbox one tiene 4gb de HBM?![uzi [uzi]](/images/smilies/nuevos2/uzi.gif)

Pero si esta memoria acaba de salir en la serie fury. Está confirmado oficialmente?

Estaríamos hablando de 8gb ddr3 + 4hbm?

Wtf?

Seria ridiculo tener un banco de memoria RAM de 4GB ahi muerto de risa. Pero claro, cada uno puede creer lo que quiera...

A ver q alguien explique esto!! Tiene 8gb de ddr3 y ahora resulta q también tiene 4gb de hbm?

Xq si es así!! Q han tenido q pasar 2 años para saberlo y poderla usar!??? Yo creo q horizonte dé sucesos se coló o algo!! Xq no puede ser!! Como lo explicas a los desarrolladores q tienen 12gb de ram en total,pero eh!! Solo hay 8 disponibles ahora dentro de dos años sacamos los otros 4 y hacemos un zasca en to la boca!!! No tiene sentido!!

Xboxman escribió:Que os parece el articulo de este personaje?

https://josepjroca.wordpress.com/2014/0 ... de-ps4-ii/

Es cierto?

•La configuración del planificador de la GPU de PS4 es igual a la que tiene la GPU Hawaii (GCN 2.0), no tiene la misma configuración en cuanto al número de Compute Units, Unidades de Texturas y ROPS pero es más avanzada que la de Xbox One en cuanto al planificador y el sistema de reparto de tareas. Sabemos que la de Xbox One es una Bonaire que es GCN 1.1

•El añadido del TrueAudio en PS4, ausente por completo en Xbox One que tiene su propia solución para el sonido.

•Onion+ en PS4, también se encuentra en el AMD Kaveri que es la APU en PC más avanzada que tiene AMD. Xbox One carece de ella.

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif) O que el planificador en la otra es GCN 2.0 y en la XOne la pobre lleva GCN 1.1, claro y los schedulers y graphics/command processors específicos para que nombrarlos siquiera ¿verdad?. Si es que

O que el planificador en la otra es GCN 2.0 y en la XOne la pobre lleva GCN 1.1, claro y los schedulers y graphics/command processors específicos para que nombrarlos siquiera ¿verdad?. Si es que

Cyborg_Ninja escribió:Ya que hablais de los ACEs, async compute etc... lei por aqui hacia tiempo que Battlefront en One no utilizaba computacion asincrona y en PS4 si, ¿me equivoco? ¿Habia fuente de eso?

Pregunto desde el mas absoluto desconocimiento

papatuelo escribió:@cercata ¿A que te refieres con eso de los 30 millones?

Es una estrategia monopolística, de aquí a dos años liberas toda la información y dejas a la competencia sin margen de maniobra, a la ve que metes barreras de entrada a competencia potencial.

Imaginar que de aquí a 2 años microsoft cuenta la realidad y que One es 3x mas potente que la competencia, en que lugar queda Sony? Con 15 millones de consolas en la calle y sin el potencial económico de desarrollar un hardware similar.. O tiran el resto de la gen con un hardware muy inferior o saltan a gaikai como ya están insinuando, además MS podría tener consecuencias legales por falsear datos de la maquina.

Zokormazo escribió:papatuelo escribió:@cercata ¿A que te refieres con eso de los 30 millones?

Creo que se refiere al quote de salocin que tiene mosotron en su firma:Es una estrategia monopolística, de aquí a dos años liberas toda la información y dejas a la competencia sin margen de maniobra, a la ve que metes barreras de entrada a competencia potencial.

Imaginar que de aquí a 2 años microsoft cuenta la realidad y que One es 3x mas potente que la competencia, en que lugar queda Sony? Con 15 millones de consolas en la calle y sin el potencial económico de desarrollar un hardware similar.. O tiran el resto de la gen con un hardware muy inferior o saltan a gaikai como ya están insinuando, además MS podría tener consecuencias legales por falsear datos de la maquina.

Supongo que se refiere a que ya lleva 30 millones de consolas en la calle

papatuelo escribió:Cyborg_Ninja escribió:Ya que hablais de los ACEs, async compute etc... lei por aqui hacia tiempo que Battlefront en One no utilizaba computacion asincrona y en PS4 si, ¿me equivoco? ¿Habia fuente de eso?

Pregunto desde el mas absoluto desconocimiento

Es bastante probable, hasta ahora los dos únicos juegos que utilizan computo asincrono en ONE son Fable y Tomb Raider.

Ningún juego de Dice ha usado esa característica en DX11, ni PC ni ONE. Pero sí lo ha utilizado en PS4.

No sé si la cosa habrá cambiado desde BF4, pero teniendo en cuenta que practicamente todos sus juegos singuen ofreciendo el mismo rendimiento lo más normal es pensar que no lo han utilizado.

@cercata ¿A que te refieres con eso de los 30 millones?

Cyborg_Ninja escribió:papatuelo escribió:Cyborg_Ninja escribió:Ya que hablais de los ACEs, async compute etc... lei por aqui hacia tiempo que Battlefront en One no utilizaba computacion asincrona y en PS4 si, ¿me equivoco? ¿Habia fuente de eso?

Pregunto desde el mas absoluto desconocimiento

Es bastante probable, hasta ahora los dos únicos juegos que utilizan computo asincrono en ONE son Fable y Tomb Raider.

Ningún juego de Dice ha usado esa característica en DX11, ni PC ni ONE. Pero sí lo ha utilizado en PS4.

No sé si la cosa habrá cambiado desde BF4, pero teniendo en cuenta que practicamente todos sus juegos singuen ofreciendo el mismo rendimiento lo más normal es pensar que no lo han utilizado.

@cercata ¿A que te refieres con eso de los 30 millones?

Siendo justos, BF4 y Battlefront no tienen la misma diferencia de rendimiento ni de coña. Si nos ceñimos a resoluciones si, pero Battlefront tiene prácticamente el mismo rendimiento y assets en ambas (incluso alguno mejor en One como la vegetación) BF4 no solo era la resolución, es que en PS4 utilizaba mejor occlusion ambiental y le sacaba 5-10fps.

Dicho esto, a mi me da que si hay mas juegos que usan computación asíncrona. Ryse creo que la utilizaba para algunos screen space reflections. Por lo que leí si es cierto que la async compute es algo menos convencional que en PS4, ergo puede que algunos multis lo usen de forma mas precaria, pero yo leí los sdk filtrados en noviembre de XB1 y DX 11.1 ya era compatible con computación asincrona.

Xboxman escribió:Que os parece el articulo de este personaje?

https://josepjroca.wordpress.com/2014/0 ... de-ps4-ii/

Es cierto?

chris76 escribió:Xboxman escribió:Que os parece el articulo de este personaje?

https://josepjroca.wordpress.com/2014/0 ... de-ps4-ii/

Es cierto?

Aunque no es el hilo correspondiente muy buena info,esto explica algunas diferencias que vemos en los juegos

chris76 escribió:Xboxman escribió:Que os parece el articulo de este personaje?

https://josepjroca.wordpress.com/2014/0 ... de-ps4-ii/

Es cierto?

Aunque no es el hilo correspondiente muy buena info,esto explica algunas diferencias que vemos en los juegos

Xboxman escribió:chris76 escribió:Xboxman escribió:Que os parece el articulo de este personaje?

https://josepjroca.wordpress.com/2014/0 ... de-ps4-ii/

Es cierto?

Aunque no es el hilo correspondiente muy buena info,esto explica algunas diferencias que vemos en los juegos

Lo puse mas que nada por la info tecnica que da, ya se que hablaba de la otra, pero no es por crear polémica.

Es por curiosidad, no me cuadraban cosas que decia.

papatuelo escribió:¿Os acordaís de que supuestamente XBOX tiene solo dos ACEs pero que en lugar de manejar los ocho hilos por ACE que es lo normal en GCN maneja 16?

Pues mirad la Fury.

En lugar de llevar 8 como sus hermans de generaciones anteriores lleva solo 4. La mitad, y supongo que rendirá cada una el doble.

Asi que tenemos 4 Aces y 2 HWS (Hardware Scheduler)